llamafile 是一种AI大模型部署(或者说运行)的方案,它的特点就是可以将模型和运行环境打包成一个独立的可执行文件,这样就简化了部署流程。用户只需要下载并执行该文件,无需安装运行环境或依赖库,这大大提高了使用大型语言模型的便捷性。本文将详细的介绍如何在 Windows 系统电脑端下载运行llamafile ,并且结合路由侠内网穿透实现外网访问本地的llamafile 。

第一步,下载 llamafile

1,先下载 llamafile ,下载包:https://www.modelscope.cn/api/v1/models/bingal/llamafile-models/repo?Revision=master&FilePath=llamafile-0.6.2.win.zip

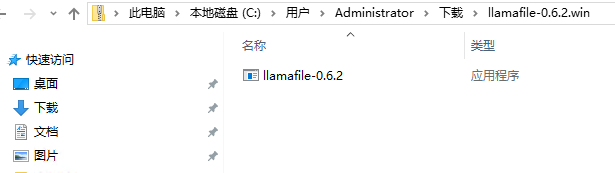

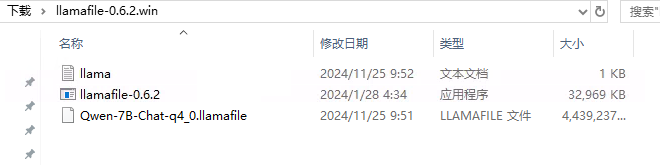

2,下载后,需要解压文件,解压后可以看到一个 llamafile.exe 文件,不用点击这个文件。

3,进入这个链接:https://www.modelscope.cn/models/bingal/llamafile-models/,去下载对应的大语言模型,本文以下载的是第一个模型为例。

4,下载好后,把下载的大语言模型和上面我们下载的 llamafile.exe 文件放在一起。

5,在 llamafile目录下,点击左上角文件,直接打开 powershell 命令窗口。

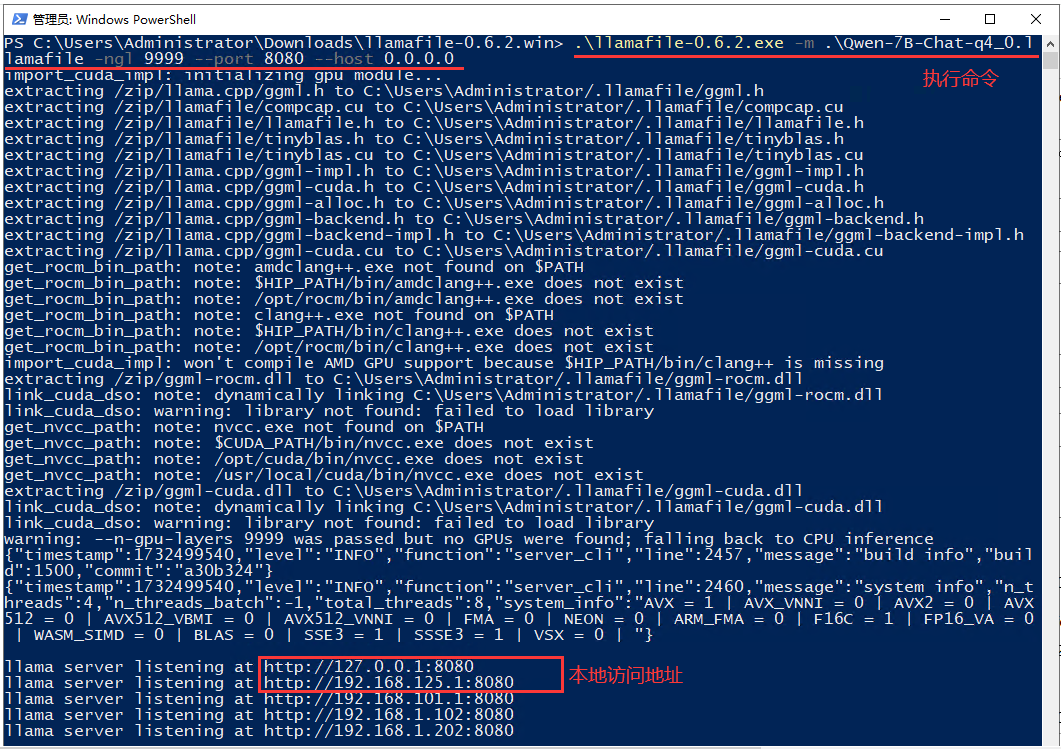

6,执行输入下面命令运行 llamafile 。

.\llamafile-0.6.2.exe -m .\Qwen-7B-Chat-q4_0.llamafile -ngl 9999 --port 8080 --host 0.0.0.0

.\llamafile-0.6.2.exe 表示运行 llamafile;

.\Qwen-7B-Chat-q4_0.llamafile 表示运行自己下载的大语言模型;

-ngl 999 表示调用 GPU 显卡运行;

8080 是 web 界面访问端口,可以自己修改;

后面 -host 默认即可。

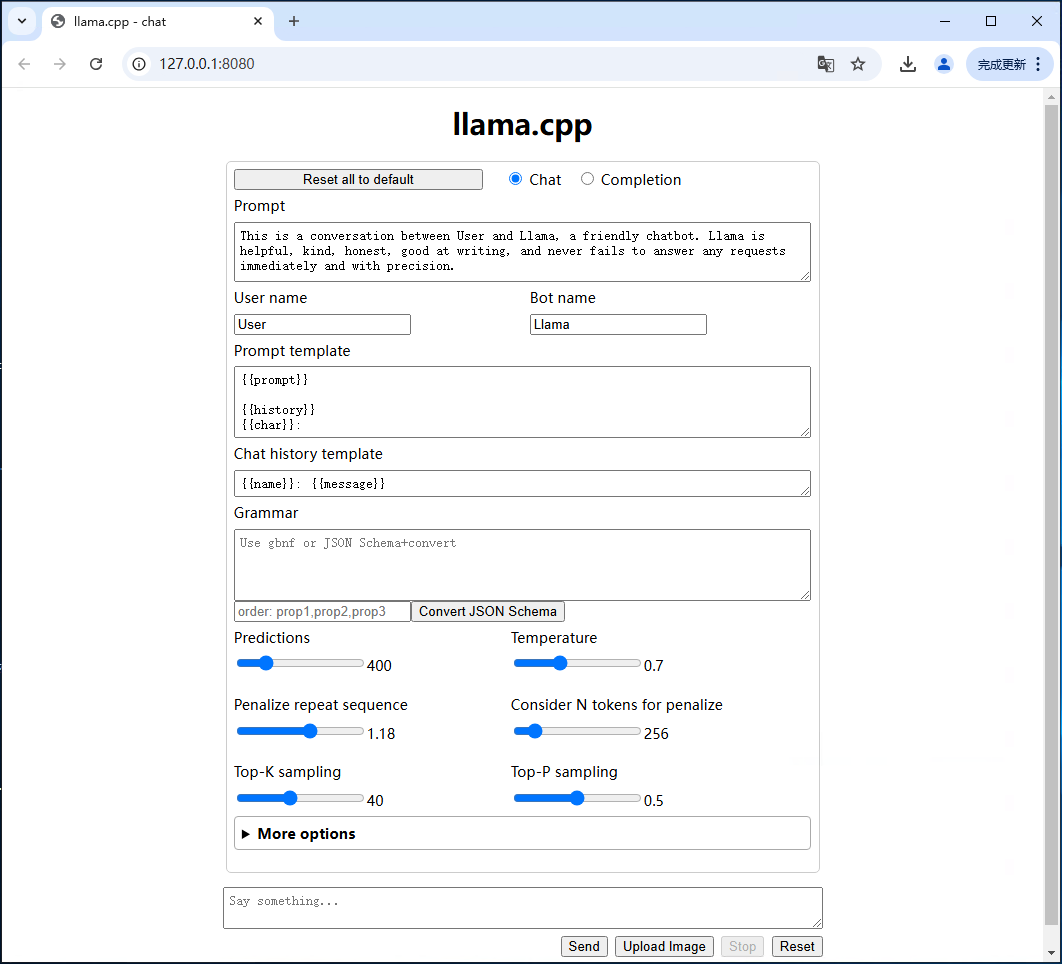

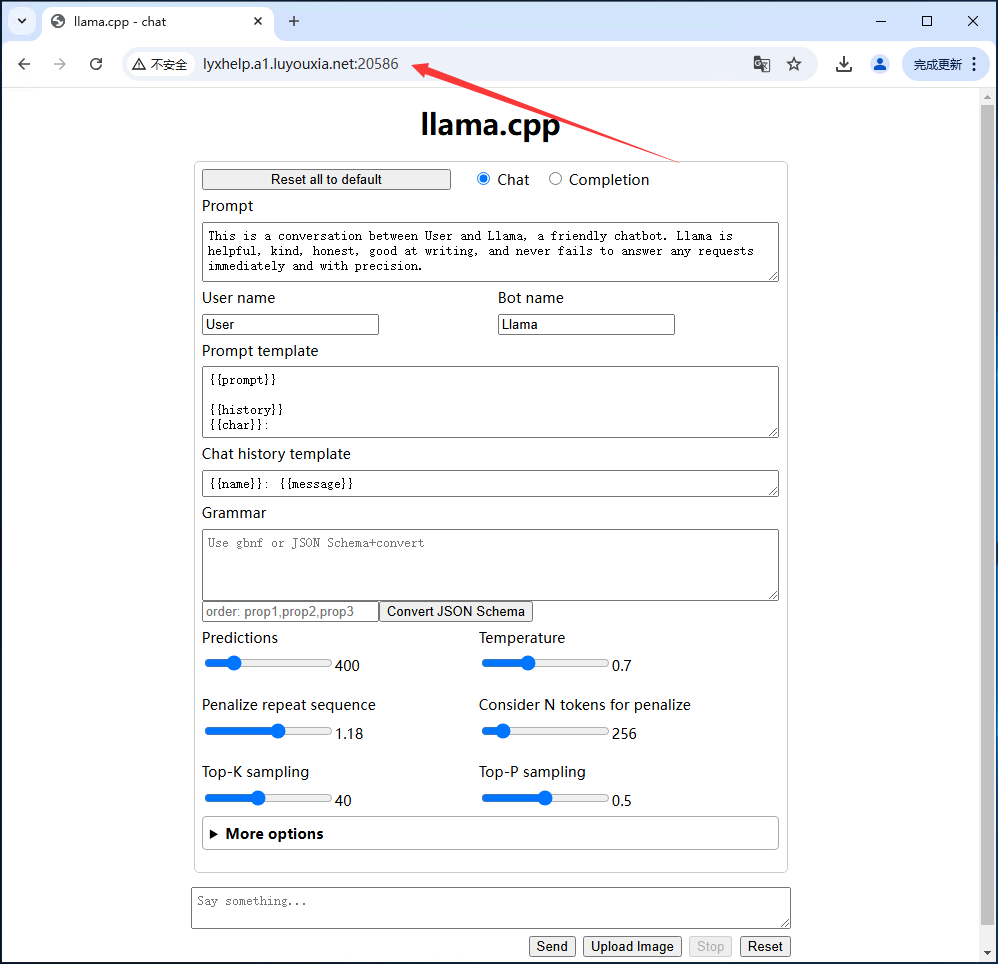

7,打开浏览器,输入本地访问地址,就能看到 llama 的 web ui 界面,这样表示启动就成功了

第二步,如何在外网访问本地局域网的 llamafile

在内网的电脑上安装路由侠,点此下载

1,下载安装完成后,打开路由侠界面,点击【内网映射】。

2,点击【添加映射】。

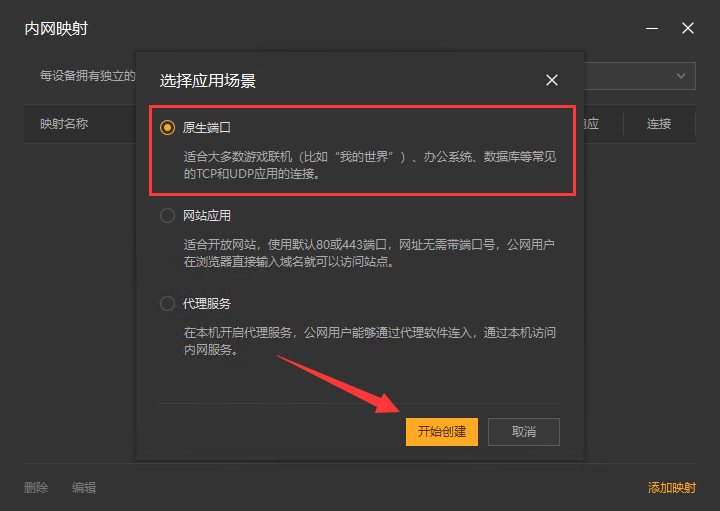

3,选择【原生端口】。

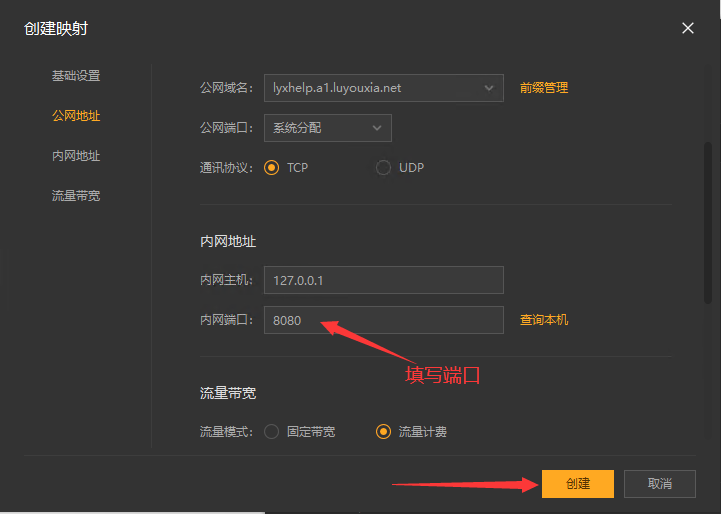

4,在内网端口里填写默认端口 8080 后点击【创建】按钮,如下图。

5,创建好后,就可以看到一条映射的公网地址,鼠标右键点击【复制地址】。

6,在外网的浏览器的地址栏输入复制的外网地址就可以访问llamafile了。

以上就是在本地局域网内安装llamafile以及利用路由侠的内网穿透平台实现外网访问本地局域网的llamafile的全部教程了,如果想要对路由侠有更多的了解,可以进官网详细了解,路由侠官网地址:www.luyouxia.com